s5unnyjjj's LOG

Beyond a Gaussian Denoiser: Residual Learning of Deep CNN for Image Denoising 본문

Beyond a Gaussian Denoiser: Residual Learning of Deep CNN for Image Denoising

s5unnyjjj 2020. 9. 27. 09:29paper : ieeexplore.ieee.org/abstract/document/7839189

< Outline >

1. Introduction

2. The Proposed Denoising CNN model

3. Experimental Results

4. Conclusion

----------------------------------------------------------------------------------------------------

1. Introduction

- Cscaed of Shrinkage Fields (CSF)와 Trainable Nonlienar Reaction Diffusion (TNRD) 같은 이전의 디노이즈 모델은 certain noise level만을 위한 학습이 가능하다.

- unknown noise level에서도 학습이 가능하도록 발전을 목표로 한다.

- noise observation을 통해 hidden layer에서 추출한 latent clean image를 제거한다.

- noisy image - latent clean image = residual image

- noise만 있는 residual image만 도출한다.

- 해당 모델을 Denoising Convolutional Neural Networks (DnCNN) 이라한다.

2. The Proposed Denoising CNN model

- Network Depth : image denoising에 맞는 효율적인 Network Depth 설정

- Residual Learning + Batch Normalization : 모델 학습을 위해 선택한 residual learning formulation과 빠른 학습 속도와 개선된 denoising 성능을 위한 Batch Normalization을 통합

- connection with Trainable Nonlinear Reaction Diffusion (TNRD) : TNRD의 한 단계를 일반화한 것이 DnCNN

2) DnCNN Network Architecture

- ( Conv + ReLU ) 1 layer + ( Conv + BN + ReLU ) 20 layers + Conv 1 layer

- noisy image - latent clear image = residual image

3) R(y)를 학습시키기 위한 residual learning formulation

- y : noisy image

- x : original clear image

- N : noisy-clean training image pairs

- R(y) : noisy image을 DnCNN에 넣었을 때 나오는 output, 즉 residual image

4) With ReLU , With BN

- weight를 조절하는 Gradient Descent Optimization Algorithm

- ReLU와 BN의 유무에 따른 PSNR 값

- Residual learning에 BN을추가했을 대, 속도와 denoising 성능이 좋다.

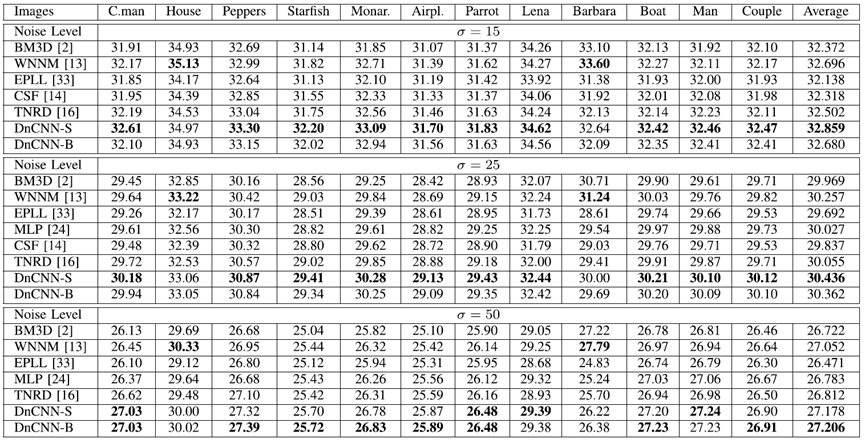

3. Experimental Results

- training : 400 images of 180x180 size

- test : 68 images from Berkely segmentation dataset(BSD68) + testing에 널리 사용되는 12 images

- DnCNN-S ( Specific noise level ) : noise level 15, 25, 50

- DnCNN-B ( Blind noise level ) : noise level 0~55

4. Conclusion

- residual learning을 noisy observation을 통해 noise를 분리하기 위함이다.

- BN과 residual learning을 같이 사용함으로써 속도와 성능이 향상되엇다.

- certain noise level을 위한 이전의 모델과는 달리 DnCNN은 unknown noise level에서 가능하다.

- 한층 더 높은 성능의 denoising이 수행 되었을 뿐만 아니라 GPU 시간도 향상되었다.

>> 부족한 점이 많을 수 있기에 잘못된 내용이나 궁금한 사항이 있으면 댓글 달아주시기 바랍니다.

>> 긴 글 읽어주셔서 감사합니다.

'Review (Paper, Code ...) > Paper Review' 카테고리의 다른 글

| Unpaired Image-to-Image Translation using Cycle-Consistent Adversarial Networks (0) | 2020.09.13 |

|---|---|

| Image-to-Image Translation with Conditional Adversarial Networks (0) | 2020.09.13 |

| DeblurGAN: Blind Motion Deblurring Using Conditional Adversarial Network (0) | 2020.09.13 |

| Densely Connected Convolutional Networks[DenseNet] (0) | 2020.09.13 |

| Conditional Generative Adversarial Nets[CGAN] (0) | 2020.09.13 |